2025年AI大模型算力需求与能效优化路径 数据中心绿色转型与产业链机遇分析

2025年AI大模型训练算力需求将突破千万PFLOPS量级,参数规模与多模态数据激增驱动算力指数级增长。与此同时,数据中心PUE(电能利用效率)优化压力加剧,液冷、芯片异构融合等技术成为能效破局关键。中研普华产业研究院预测,国产算力产业链将迎来结构性机遇,AI服务器市场规模有望超3000亿元,绿色数据中心投资占比提升至45%以上。

一、算力需求与能效矛盾成行业焦点

2025年全球AI大模型训练算力需求预计达1.2×10^25 Flops,较2023年增长超10倍。这一增长由三方面驱动:

参数规模指数级扩张:主流大模型参数量突破万亿级,单模型训练成本超5000万元多模态数据爆发:文本、图像、视频融合训练使算力消耗提升百倍推理需求下沉:企业级AI应用普及带动推理算力占比升至60%与此同时,数据中心能效挑战凸显:传统风冷技术PUE值普遍高于1.5,而头部企业通过液冷+芯片定制已将PUE压降至1.1以下。算力需求激增与能耗约束的矛盾,成为产业链升级的核心命题。

根据中研普华产业研究院发布《2025-2030年中国AI大模型行业竞争格局分析与未来趋势预测报告》显示分析

二、算力需求激增:大模型参数与数据双轮驱动

1. 参数规模决定算力消耗量级

以1750亿参数模型为例,单次训练需2917台A100服务器连续运行24天。若参数增至万亿级,算力需求将呈非线性增长。

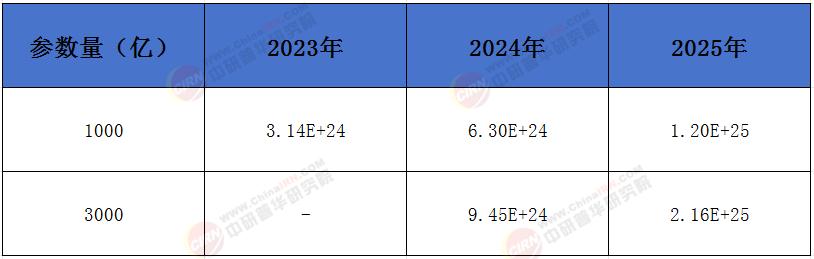

图表1:2023-2025年大模型参数与算力需求关系

2. 多模态数据重构算力分配

文本、图像、视频融合训练使算力需求分化:

训练阶段:视频数据算力消耗为文本的100倍推理阶段:实时交互场景要求毫秒级响应,需专用推理芯片图2:2025年多模态算力分配预测

多模态算力分配

三、能效挑战:绿色数据中心的技术革新

1. 液冷技术降本增效

单机柜功耗:AI集群达30kW,传统风冷无法满足散热需求PUE对比:风冷1.8 vs. 冷板液冷1.2 vs. 浸没式液冷1.05成本回收期:液冷改造初始投入增加20%,但3年内可通过节电回本2. 算力异构融合实践

CPU+GPU+ASIC组合:英伟达H100训练效率较A100提升3倍,国产昇腾910B达其80%性能算力调度平台:多云协同使资源利用率从40%提升至75%

四、产业链与投资机遇

AI算力产业链核心环节

产业链

硬件层:AI服务器市场规模将超3000亿元,国产GPU占比突破25%软件层:模型压缩技术使推理能耗降低70%服务层:算力租赁市场规模预计达600亿元,年复合增长率45%

五、中研普华产业研究院观点

国产替代窗口期:美国对华AI算力限制政策加速国产芯片生态成熟,2025年自主可控算力占比将超30%能效标准趋严:一线城市要求新建数据中心PUE≤1.25,液冷渗透率需达50%以上垂直行业机会:金融、医疗等领域专用模型崛起,推理算力需求占比提升至60%

中研普华产业研究院战略建议

技术路径:优先布局冷板式液冷与模型量化技术,平衡能效与改造成本生态协同:联合头部企业建立国产算力联盟,推动软硬件适配标准投资重点:关注AI服务器ODM厂商与液冷设备供应商,规避低端芯片产能过剩风险2025年将是AI算力“质变”与“量变”共振之年。企业需在算力军备竞赛中兼顾能效优化,方能在技术迭代与政策约束的双重挑战下抢占先机。

如需获取更多关于AI大模型行业的深入分析和投资建议,请查看中研普华产业研究院的《2025-2030年中国AI大模型行业竞争格局分析与未来趋势预测报告》。

研究院服务号

研究院服务号

中研网订阅号

中研网订阅号