2018年OpenAl正式发布GPT(生成式预训练语言模型),可以生成文章、代码、机器翻译等,GPT是ChatGPT的前身,最终形成的ChatGPT是优化版本的对话语言模型。预计GPT-4模型的参数量仍将进一步增长,根据天翼智库,给GPT-3喂料的长度每次不能超过大约2000个字,现在GPT-4的1

服务器构成:主要硬件包括处理器、内存、芯片组、I/O(RAID卡、网卡、HBA卡)、硬盘、机箱(电源、风扇)。以一台普通的服务器生产成本为例,CPU及芯片组大致占比50%左右,内存大致占比15%左右,外部存储大致占比10%左右,其他硬件占比25%左右。

服务器的逻辑架构和普通计算机类似。但是由于需要提供高性能计算,因此在处理能力、稳定性、可靠性、安全性、可扩展性、可管理性等方面要求较高。

逻辑架构中,最重要的部分是CPU和内存。CPU对数据进行逻辑运算,内存进行数据存储管理。

服务器的固件主要包括BIOS或UEFI、BMC、CMOS,OS包括32位和64位。

服务器市场规模持续增长。根据Counterpoint的全球服务器销售跟踪报告,2022年,全球服务器出货量将同比增长6%,达到1380万台。收入将同比增长17%,达到1117亿美元。根据IDC、中商产业研究院,我国服务器市场规模由2019年的182亿美元增长至2022年的273.4亿美元,复合年均增长率达14.5%,预计2023年我国服务器市场规模将增至308亿美元。

竞争格局:根据IDC发布的《2022年第四季度中国服务器市场跟踪报告Prelim》,浪潮份额国内领先,新华三次之,超聚变排行第三,中兴通讯进入前五。

2022年12月,OpenAI的大型语言生成模型ChatGPT火热,它能胜任刷高情商对话、生成代码、构思剧本和小说等多个场景,将人机对话推向新的高度。全球各大科技企业都在积极拥抱AIGC,不断推出相关技术、平台和应用。

生成算法、预训练模式、多模态等AI技术累计融合,催生了AIGC的大爆发。

目前,AIGC产业生态体系的雏形已现,呈现为上中下三层架构:①第一层为上游基础层,也就是由预训练模型为基础搭建的AIGC技术基础设施层。②第二层为中间层,即垂直化、场景化、个性化的模型和应用工具。③第三层为应用层,即面向C端用户的文字、图片、音视频等内容生成服务。

GPT模型对比BERT模型、T5模型的参数量有明显提升。GPT-3是目前最大的知名语言模型之一,包含了1750亿(175B)个参数。在GPT-3发布之前,最大的语言模型是微软的TuringNLG模型,大小为170亿(17B)个参数。GPT-3的paper也很长,ELMO有15页,BERT有16页,GPT-2有24页,T5有53页,而GPT-3有72页。

训练数据量不断加大,对于算力资源需求提升。

回顾GPT的发展,GPT家族与BERT模型都是知名的NLP模型,都基于Transformer技术。GPT,是一种生成式的预训练模型,由OpenAI团队最早发布于2018年,GPT-1只有12个Transformer层,而到了GPT-3,则增加到96层。其中,GPT-1使用无监督预训练与有监督微调相结合的方式,GPT-2与GPT-3则都是纯无监督预训练的方式,GPT-3相比GPT-2的进化主要是数据量、参数量的数量级提升。

在AI实现的过程中,训练(Training)和推理(Inference)是必不可少的,其中的区别在于:

训练过程:又称学习过程,是指通过大数据训练出一个复杂的神经网络模型,通过大量数据的训练确定网络中权重和偏置的值,使其能够适应特定的功能。

推理过程:又称判断过程,是指利用训练好的模型,使用新数据推理出各种结论。

简单理解,我们学习知识的过程类似于训练,为了掌握大量的知识,必须读大量的书、专心听老师讲解,课后还要做大量的习题巩固自己对知识的理解,并通过考试来验证学习的结果。分数不同就是学习效果的差别,如果考试没通过则需要继续重新学习,不断提升对知识的掌握程度。而推理,则是应用所学的知识进行判断,比如诊断病人时候应用所学习的医学知识进行判断,做“推理”从而判断出病因。

AI服务器作为算力基础设备有望受益于算力需求持续增长

AI服务器作为算力基础设备,其需求有望受益于AI时代下对于算力不断提升的需求而快速增长。

根据TrendForce,截至2022年为止,预估搭载GPGPU(GeneralPurposeGPU)的AI服务器年出货量占整体服务器比重近1%,预估在ChatBot相关应用加持下,有望再度推动AI相关领域的发展,预估出货量年成长可达8%;2022~2026年复合成长率将达10.8%。

AI服务器是异构服务器,可以根据应用范围采用不同的组合方式,如CPU+GPU、CPU+TPU、CPU+其他加速卡等。IDC预计,中国AI服务器2021年的市场规模为57亿美元,同比增长61.6%,到2025年市场规模将增长到109亿美元,CAGR为17.5%。

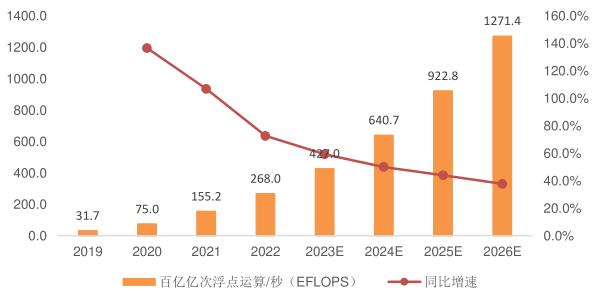

图表:中国算力发展情况

用户快速增长+模型持续迭代+应用场景的不断扩张或将使AI服务器需求超预期

ChatGPT用户数快速增加,上线仅5天,用户数便突破百万,上线两月后,ChatGPT月活用户数突破1亿,根据Similarweb统计,OPENAI网站用户访问量快速增长,我们预计未来用户数仍将快速提升,带来交互对话的产生,提升推理所需算力基础设施需求。

2018年OpenAl正式发布GPT(生成式预训练语言模型),可以生成文章、代码、机器翻译等,GPT是ChatGPT的前身,最终形成的ChatGPT是优化版本的对话语言模型。预计GPT-4模型的参数量仍将进一步增长,根据天翼智库,给GPT-3喂料的长度每次不能超过大约2000个字,现在GPT-4的“消化能力”提升了10倍以上。

带来AI应用生态的繁荣,未来有望涌现更多应用场景。

据gpt3demo.com网站统计,目前基于ChatGPT推出的应用表现出高度活跃和极度丰富特性,截止2023年3月6日已有620个案例。从生成的内容格式来看可以把目前所有案例分为五大类,即文本生成、代码生成、图像生成、音频生成、和视频生成。其中文本生成是目前最主要的应用方向,有397个案例,占比达64.1%;随后是代码生成92个案例,占比14.7%;图像生成73个案例,占比11.8%;音频生成29个案例,占比4.7%;视频生成16个案例,占比2.6%。

下游应用场景有望持续拓展。目前ChatGPT的主要应用场景包括但不限于无代码编程、小说生成、对话类搜索引擎、语音陪伴、语音工作助手、对话虚拟人、人工智能客服、机器翻译、芯片设计等。随着算法技术和算力技术的不断进步,ChatGPT也有望进一步走向更先进功能更强的版本,在越来越多的领域进行应用,为人类生成更多更美好的对话和内容。

AI服务器核心组件包括GPU(图形处理器)、DRAM(动态随机存取存储器)、SSD(固态硬盘)和RAID卡、CPU(中央处理器)、网卡、PCB、高速互联芯片(板内)和散热模组等。

CPU主要供货厂商为Intel、GPU目前领先厂商为国际巨头英伟达,以及国内厂商如寒武纪、海光信息等。

内存主要为三星、美光、海力士等厂商,国内包括兆易创新等。

SSD厂商包括三星、美光、海力士等,以及国内江波龙等厂商。

PCB厂商海外主要包括金像电子,国内包括沪电股份、鹏鼎控股等。

主板厂商包括工业富联,服务器品牌厂商包括浪潮信息、紫光股份、中科曙光、中兴通讯等。

关注公众号

免费获取更多报告节选

免费咨询行业专家

2023-2028年中国智慧招商行业市场深度调研及投资策略预测报告

智慧招商是将大数据和互联网技术应用于园区招商的实践经验。利用大数据、云计算等现代高科技手段,解决园区投资运营难、企业入园投资难的问题。突破了时间和地域的限制,提高了招商效率,节省了...

查看详情

鸿蒙是面向IOT的新一代智能操作系统,同时兼容移动端,可以针对不同IOT设备任意裁剪适配,鸿蒙可支撑渗透的领域包括AP...

智能家居:智能化的家庭系统,增加生活便利、舒适、安全。智能家居是指通过互联网技术和智能设备,将家庭设备、家庭电...

谷歌公司业务种类多,覆盖范围广:谷歌公司(GoogleInc.)成立于1998年9月4日,是全球最大的科技公司之一。主要产品覆...

近期,ChatGPT的爆红引发了人们对于人工智能发展的高度关注。2022年11月30日,OpenAI发布语言模型ChatGPT。该模型采用...

AI医疗产业主要包括上游基础层,中游技术层,下游应用层。行业巨头偏向基础层,在算力等领域已呈寡头局面,技术壁垒较...

2022年上半年,国内体育相关公司的投融资事件共有33起,其中透露了投融资金额的共29起,总额约合10.738亿元人民币。20...

微信扫一扫

微信扫一扫