当前,全球数字经济正以前所未有的速度演进,作为数字基础设施的核心,服务器行业迎来了历史性的发展窗口。随着人工智能(AI)大模型从技术探索走向大规模应用,算力需求呈现指数级增长,服务器不再仅仅是数据存储与处理的通用设备,而是成为了驱动智能世界运转的“发动机”。2026年,全球服务器行业正处于从“规模扩张”向“架构重构”转型的关键节点。

从宏观视角来看,行业呈现出“需求爆发、架构重塑、绿色转型”的三大显著特征。一方面,全球云服务提供商(CSP)持续加大资本支出,为行业提供了强劲的市场动力;另一方面,AI技术的深度渗透迫使服务器技术架构从以CPU为中心向异构计算转变,同时散热技术的革新也成为行业关注的焦点。

一、2026年全球服务器行业发展现状:架构重塑与供需博弈

根据中研普华产业研究院发布的《2026年全球服务器行业总体规模、主要企业国内外市场占有率及排名》显示:2026年的服务器行业,正处于技术迭代与市场洗牌并存的深水区。传统的通用计算模式已难以满足AI大模型训练与推理的庞大需求,行业在技术架构、供应链关系以及盈利模式上均发生了深刻变化。

1.1 技术架构变革:从“CPU中心”迈向“异构计算”

延续半个多世纪的以CPU为中心的主从架构正在瓦解,取而代之的是面向AI与多元负载的多样化平等计算架构。在2026年,异构计算已成为行业主流,服务器内部集成了CPU、GPU、NPU、DPU以及ASIC等多种处理器。这些处理器地位平等,通过高速互联总线形成统一的资源池,能够根据任务需求进行精准调度与协同作业。

这种架构的转变,主要是为了应对AI大模型参数量激增带来的“通信墙”与“内存墙”挑战。通用计算与专用计算走向分化,ARM架构在数据中心快速渗透,而GPU主导了AI训练市场,NPU和ASIC则聚焦于能效比要求更高的推理场景。产业价值链随之重构,价值重心从单一的CPU芯片向GPU、AI加速器以及高速互联技术、异构软件栈转移。

1.2 产业链博弈:上游资源紧缺与下游需求分化

在产业链上游,核心资源的供需关系呈现出高度紧张的状态。随着AI基础设施建设的加速,存储芯片与服务器CPU的需求持续旺盛,导致部分高端元器件出现供应紧缺与价格上调的现象。特别是高带宽内存(HBM)和高性能NAND闪存,已成为制约服务器出货的关键因素之一。此外,铜矿等原材料资源的供应稳定性也对服务器制造构成了挑战,推动了再生材料在产业链中的应用。

在产业链下游,需求端呈现出明显的分化趋势。北美五大云服务提供商(CSP)为了加速AI应用导入,持续维持高额的资本支出,重点采购高性能AI服务器以支撑大模型训练。与此同时,随着AI应用从训练转向推理,通用型服务器也迎来了替换与扩张周期,以应对日益增长的推理流量。这种“训练+推理”双轮驱动的需求结构,使得服务器市场比往年更加活跃。

1.3 行业盈利特征:规模扩张与毛利承压并存

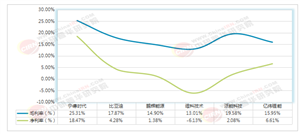

尽管市场需求旺盛,但服务器整机制造行业“规模大、盈利弱”的特征在2026年依然显著。从行业整体来看,服务器厂商的毛利率普遍处于相对偏低水平,且呈现走低趋势。这与上游光模块、芯片厂商的高毛利形成了鲜明对比。

造成这一现象的原因是多方面的:一方面,核心零部件成本攀升,且上游芯片厂商拥有较强的议价能力;另一方面,下游云服务提供商(CSP)规模庞大,采购议价能力强,进一步压缩了整机厂商的利润空间。此外,市场竞争加剧也迫使厂商在价格上做出让步。因此,如何在扩大规模的同时,通过优化盈利结构和提升技术服务附加值来改善毛利水平,是当前服务器厂商面临的共同难题。

2026年,全球服务器市场规模持续扩容,其背后的驱动力不仅来自于传统的数字化转型,更来自于AI算力基建的爆发式投入以及散热技术的代际更替。

2.1 资本支出激增:全球算力基建的“军备竞赛”

全球服务器市场的增长与云服务提供商(CSP)的资本支出(CAPEX)高度正相关。2026年,全球主要CSP的资本支出预计将创下新高,年增长率显著提升。这些资金绝大部分被用于算力采购,包括建设数据中心、购置AI服务器、芯片和网络设备等。

从区域来看,北美市场依然领跑,科技巨头们为了在AI竞赛中保持领先,不惜重金投入基础设施建设。与此同时,亚太市场特别是中国市场,凭借“东数西算”等政策红利和庞大的本土应用需求,也展现出强劲的增长势头。这种全球范围内的“军备竞赛”,直接拉动了服务器市场的出货量,尤其是AI服务器,其出货量增速远超通用服务器,成为市场增长的核心引擎。

2.2 液冷市场爆发:散热技术的“iPhone时刻”

随着AI芯片性能的不断提升,其功耗也突破了物理极限,单个芯片的功率轻松突破千瓦大关,这使得传统的风冷散热方案已无法应对。2026年,被行业视为液冷服务器的“iPhone时刻”,液冷技术从边缘走向中心,成为高功率密度数据中心的标配。

市场规模方面,全球服务器液冷市场空间在2026年有望达到数百亿元量级。液冷技术的渗透率正经历从政策驱动向技术刚需的加速跃迁。特别是在搭载高性能GPU的AI服务器中,液冷方案的渗透率大幅提升。这不仅是一个技术升级的过程,更是一个巨大的增量市场。从成本结构来看,液冷板、快接头和冷量分配单元(CDU)占据了系统成本的主要部分,掌握这些核心零部件技术的企业将在这一波浪潮中获益。

2.3 细分品类增长:AI训练与推理的双向拉动

在品类层面,市场呈现出差异化的增长态势。AI训练服务器依然是营收增长的核心引擎,随着大模型参数量的不断攀升,对高性能计算集群的需求持续旺盛。与此同时,通用服务器市场逐步回归常态增长,主要受AI推理需求和企业数字化转型的拉动。

值得注意的是,随着AI应用落地,推理服务器的需求正在快速释放。智能体(Agent)的崛起和各类AI应用的普及,使得Token消耗量呈指数级扩张,这为推理服务器市场带来了巨大的增量空间。此外,高性能计算(HPC)服务器在科学计算、生物医药等领域的应用也在稳步增长,进一步丰富了服务器市场的结构。

展望未来,服务器行业将不再局限于硬件性能的堆叠,而是向着系统级创新、绿色低碳以及生态开放的方向演进。

3.1 超节点与集群化:算力架构的系统级创新

面对十万亿级参数的大模型与海量的智能体任务,传统的单服务器架构已遭遇瓶颈。未来,超节点(Super Node)将成为智算中心的新底座。超节点通过高速互联和内存统一编址,将数百至数千颗AI芯片整合为一个统一的计算体,从而突破内存墙和通信墙的限制,提供极高的带宽和极低的时延。

这种架构并非简单的硬件堆叠,而是计算、存储、网络的系统级创新。未来,智算中心将全面进入超节点时代,通过集群化部署,实现算力效能的质变。这也将推动行业从单纯的服务器销售,向提供全栈集群解决方案转型。

3.2 绿色化与液冷普及:能源成为核心约束

在全球碳中和的背景下,能源已成为服务器行业发展的核心约束。未来,智算中心将呈现出高密化、液冷化、集群化的三大特征。随着芯片功耗的进一步提升,液冷技术将成为绝对的主流,浸没式液冷等高效方案将加速替代冷板式,推动数据中心能源使用效率(PUE)向极限值逼近。

此外,算电协同将成为重要趋势。数据中心将更多地采用绿电直供、微电网和储能技术,结合液冷和余热回收,实现真正的绿色低碳运行。这不仅是为了满足政策合规要求,更是企业降低运营成本、提升竞争力的必然选择。

3.3 开源开放与生态竞争:从单打独斗到全栈协同

随着智算时代产业链复杂度的提升,开源开放将成为破局的关键。头部厂商将通过开源模型、框架和工具链来构建生态壁垒,降低开发门槛,加速技术迭代。异构计算将成为常态,不同厂商的芯片架构差异显著,这将催生对统一软件抽象层、高效互联和智能调度的巨大需求。

未来的行业竞争,将超越单一产品的维度,演变为涵盖芯片、算法、应用的全生态竞争。拥有全栈能力、能够构建“硬件定义算法、算法优化硬件”闭环的企业,将在全球科技竞争中占据先机。同时,中小企业也将通过在垂直领域的深耕和生态协同,找到自己的生存空间。

总结

2026年的全球服务器行业正处于一个充满机遇与挑战的变革期。在AI浪潮的推动下,市场规模持续扩大,技术架构深刻重塑,绿色转型加速推进。对于行业参与者而言,唯有紧跟技术趋势,构建自主创新的生态体系,方能在这一轮算力新纪元中立于不败之地。

想要了解更多行业专业分析请点击中研普华产业研究院出版的《2026年全球服务器行业总体规模、主要企业国内外市场占有率及排名》。

研究院服务号

研究院服务号

中研网订阅号

中研网订阅号